人工智能伦理(一):人工智能技术的利弊

| 站点: | 科创教育数字化教学平台 |

| 课程: | 人工智能教学指南与实操(中学) |

| 图书: | 人工智能伦理(一):人工智能技术的利弊 |

| 打印: | 访客用户 |

| 日期: | 2025年08月12日 星期二 00:40 |

1. 项目概述

在这个项目中,学生探索各种人工智能技术的机遇和不足。在这个过程中,他们会考虑受人工智能技术影响的利益相关者,检查人工智能设计和使用中涉及的利弊,并考虑他们在个人生活和他人生活中能够影响人工智能技术的伦理使用的方式。

学科:科学、计算机科学、英语语言艺术、公民学、政府学

时长:3-8小时

适用年级:6-12

词汇:积极收集数据、人工智能、行动呼唤、伦理的、伦理观、模型卡、被动数据采集、利益相关者、权衡

项目目标

- 理解所有的决定,包括那些由人工智能做出的决定,及其利弊。

- 描述使用或实施各种人工智能技术的利弊。

- 对他们共享的数据和使用的人工智能技术做出更明智的决定。

- 阐述与人工智能技术使用相关的个人职位。

标准

ISTE学生标准

1.授权的学习者

d.学生理解技术操作的基本概念,具有选择、使用和解决现有技术问题的能力,并能够运用所学知识探索新兴技术。

2.数字公民

d.学生管理他们的个人数据,以维护数字隐私和安全,并了解用于跟踪其在线导航的数据收集技术。

3.知识建构者

d.学生通过积极探索现实问题和问题,发展想法和理论,寻求答案和解决方案来构建知识。

4.创新设计师

d.学生表现出对歧义的容忍,毅力和解决开放式问题的能力。

6.创造性沟通

c.学生通过创造或使用各种数字对象,如可视化、模型或模拟,清晰有效地传达复杂的想法。

d.学生发布或呈现内容,为他们的目标受众定制信息和媒体。

7.全球合作伙伴

c.学生对项目团队做出建设性的贡献,承担不同的角色和责任,为一个共同的目标有效地工作。

ISTE计算思维素养

1.计算思维

e. 认识到计算机和社会如何相互作用,为个人和组织创造机会、不平等、责任和威胁。

2.公平的领导者

e.与学生、家长和领导沟通,了解计算机如何影响世界、不同角色和职业生活,以及为什么这些技能对所有学生都至关重要。

3.创意与设计

c.指导学生注重开发具有广泛可访问性和可用性的计算工件的多元化视角和以人为中心的设计。

AI4K12 AI的五大理念

1.感知:计算机利用传感器感知世界。

2.表示和推理:代理主张世界的表示并使用它们进行推理。

3.机器学习:计算机可以从数据中学习。

4.自然交互:智能代理需要多种知识才能与人类进行自然的交互。

5.社会影响:人工智能可以对社会产生积极和消极的影响。

CSTA K-12计算机科学标准

- 2-IC-20:比较计算机技术对人们日常活动和职业选择的影响。

- 2-IC-23:描述信息公开和保持信息隐私和安全之间的利弊。

- 3A-IC-24:评估计算机对个人、伦理、社会、经济和文化实践的影响。

- 3A-IC-29:解释通过自动化过程收集和生成数据的相关隐私问题,可能对用户不明显。

- 3B-AP-08:描述人工智能如何驱动许多软件和物理系统。

- 3B-IC-28:讨论影响软件开发和使用的法律法规。

英语语言艺术共同核心国家标准

- CCSS.ELA-LITERACY.W.6.1-11-12.1:用清晰的理由和相关的证据写论点来支持主张。CCSS.ELA-LITERACY.WHST.6-8.7:进行简短的研究项目来回答一个问题(包括一个自我产生的问题),利用几个来源并产生额外的相关的、重点突出的问题,以允许多种探索途径。ccs。

- CCSS.EL A- LITERACY.WHST .9-10.7/11-12.7:进行短期和更持久的研究项目,以回答一个问题(包括一个自我产生的问题)或解决一个问题;适当时缩小或扩大调查范围;综合有关主题的多个来源,展示对调查主题的理解。

2. 项目准备

材料准备

- 联网的计算机或平板电脑以访问工具和在线资源

- 书写材料,如纸、笔、铅笔

- 下面列出在线文章,工具,和资源

- 可选:The Trade-offs of AI Technology的数字拷贝文件:活动3为每个学生或小组提供graphic organizer

- 可选:活动3期间观看视频的耳机

- 文章: “Ethical Concerns of AI”

- 文章: “Top 9 ethical issues in Artificial Intelligence”

- 文章: “1st Party Data, 2nd Party Data, 3rd Party Data: What Does It All Mean?”

- 视频:

- 网站: DigCitCommit

- 书: Blown to Bits: Your Life, Liberty, and Happiness after the Digital Explosion by Hal Abelson, Ken Leedon, and Harry Lewis

高级准备

这个项目可以通过以下几种不同的方式进行,这取决于你在课程中可用的时间。在开始项目之前,确定您使用下列哪种方式。

- 如果你的课堂时间被限制在3-4小时的项目时间,将你的注意力集中在活动1-3上,对活动3使用拼图教学策略,并让学生用活动3的课堂演示和讨论结束项目。

- 如果你有4-8小时的项目时间,按照书面规定完成项目活动。使用你所拥有的时间分配来确定学生的深度工作的小组演讲活动3或最终性能选项A或B。

- 如果你有8小时或更多,这个项目可以为一个完整的单元提供了一个框架在人工智能和道德规范。在活动3中,不要使用拼图教学策略,而是让所有学生探索所列的7种人工智能技术中的每一种。在最终表现方面,学生可以完成选项A和B,甚至作为个人、小组或一个班来就他们的行动呼吁进行演讲,分享他们已经学习了人工智能,伦理,与学生、教育者、父母或社区的利弊。

- 或者,这个项目也可以在技术、计算机科学、英语语言艺术、公民学和政府课程的交叉课程中使用。例如,一名中学技术教师可能教活动1-3,而英语语言艺术或公民教育教师随后教活动4-6。

整个项目中有很多媒体资源的链接,包括向全班展示的视频和供学生独立或小组探索的资源。上课前,回顾材料并决定如何分发给学生。例如,如果您选择使用The Trade-offs of AI Technology: Activity 3 graphic organizer,它以谷歌Doc格式提供。当你为这个项目做准备时,制作你自己可编辑的副本,编辑或更新你需要的问题或资源,并以你喜欢的格式分发给你的学生。

3. 活动1:人工智能和权衡

1. 介绍这个项目,并给出人工智能的定义和描述。

根据第一个创造了这个术语的约翰·麦卡锡(John McCarthy)的说法,人工智能是“制造智能机器,尤其是智能计算机程序的科学和工程”(McCarthy, 2007)。由人工智能推动的技术,能够使用传感器来有意义地感知周围的世界,分析和组织它所感知的数据,并自主地使用这些数据来做出预测和决策。

2. 让学生观看视频“What Is Artificial Intelligence? #1”

3. 说:“在视频中,你看到了人工智能技术的许多不同应用。Jabril提到,一些人对人工智能的影响感到兴奋,而另一些人可能害怕它。与任何新技术一样,使用它也会有利有弊。权衡(trade-offs)是两种或两种以上的理想选择之间的平衡或妥协,但它们相互竞争或不兼容。”

4. 为了帮助强化权衡的概念,和你的学生玩一个“你更愿意”风格的游戏。对于下面的每一个权衡的例子(或者你根据学生的兴趣创建的其他例子),大声朗读提示,然后让学生投票选择。在进入下一个场景之前,简要讨论选择其中一个行动相对于另一个行动的结果。

权衡案例:

- 你坐校车回家需要20分钟。你读书还是玩电子游戏?

- 你不小心睡过头了,结果在上学时间之前醒来。你会花时间在离家前梳头,即使这意味着迟到,还是头发乱糟糟但是准时到校?

- 周五晚上,你的家人要举行家庭晚宴来庆祝父母的生日,但你的朋友希望你和他们一起去参加学校的活动。你会怎么做?

- 周三下午你只有两个小时的空闲时间。你是完成第二天上学要做的两个小时的家庭作业,还是和朋友去当地的咖啡店闲逛?

- 你在一个主题公园,有两种游乐设施你一直很想尝试:过山车和水上游乐,但队伍太长,你只能在公园关门前乘坐其中一种。你会选哪一个?

- 这是周六晚上,你在家里闲着。你会熬夜看别人都在看的电视连续剧,还是为了睡个好觉而早早上床?

- 你的老师正在为即将到来的一场大考做复习,但你感到口袋里的手机在不停地响。你是为了专注复习而忽略它,还是冒着错过重要内容的风险查看手机?

5. 通过在伦理的背景下构建权衡决策来结束这一活动,包括以下关键点:

- 你也许能从以上活动中发现,在任何情况下,我们并不能总是在最佳决策上达成一致。我们每个人都是根据当时的个人优先事项和价值体系做出选择的。这些价值观是由我们的经历、文化、背景、兴趣和其他因素决定的。

- 伦理学是研究支配人行为的道德原则和体系的学科。它是一门研究人们用来决定孰是孰非的系统学科。当人们说做某件事合乎道德时,通常是指他们认为这是合乎道德的事。

- 就像我们刚刚探讨的决策一样,各种指标或价值可能被用来确定人工智能技术的伦理影响,比如它是合法的、公平的、有益的还是有害的。

- 在这个项目中,我们将探索各种人工智能技术,检查它们的设计和使用中涉及的权衡,并考虑你个人可以影响人工智能技术伦理使用的方式。

4. 活动2:人工智能数据收集与应用

在这项活动中,学生们思考如何在共享数据的同时,从人们日常生活中使用的人工智能技术中获得利益或便利。然后,他们会考虑共享数据的潜在风险和意外后果。

1. 通过以下内容介绍小组活动:

1)说:“在我们之前观看的视频中,我们看到,就像对待人类婴儿一样,机器学习需要大量的数据来学习。它还需要来自用户或环境的数据,以便应用它所学到的知识、交流、生成新数据、预测结果或做出决策。人工智能拥有的数据集越好,它在执行任务时的表现就越好。作为个人或社会,我们已经决定放弃我们的一些隐私或自由,以换取人工智能技术提供的好处,如方便、个性化或自动化。这是一个权衡的例子。

2)让学生观看TED演讲视频 “Your social media “likes” expose more than you think”by Jennifer Golbeck.

3)说:“正如你从视频中看到的,我们有很好的理由更仔细地考虑这种权衡。无论何时收集数据,都需要考虑数据使用和隐私问题。”

4)比如,“哈尔·艾贝尔森(Hal Abelson)、肯·利登(Ken Leedon)和哈里·刘易斯(Harry Lewis)合著的《支离破碎:数字爆炸后的你的生活、自由和幸福》(Blown to Bits: Your Life, Liberty, and Happiness after the Digital Explosion)一书中,作者描述了两种由技术收集的数据:足迹和指纹。

- 足迹——有时被称为主动的数据收集(active data collection)——是您知道将要留下并可能期望被其他人看到或使用的数据。例如,如果你在一个网站上创建了一个新帐户,你可能会告诉他们你的名字、电子邮件、地点或生日。

- 指纹——有时也称为被动的数据收集(passive data collection)——是指您可能不会想到或希望留下的数据,但应用程序正在收集或跟踪这些数据。例如,跟踪你点击了什么链接,查看了谁的资料,甚至跟踪你没有选择但没有停止自动播放的视频。

2. 在这个活动中,学生以三到四人为一组,思考下面列出的每一种人工智能技术工具,并分别指出收集的数据哪些称为足迹,哪些称为指纹,以及用户从分享这些数据中得到了什么。在课堂上一起分析第一个技术,然后从列表中给每个小组分配两到三个技术。小组学生进行10-15分钟的头脑风暴并写下他们的想法,再在整个班级中讨论每一个技术。将学生的答案记录在白板或数字表格中。为了支持您实施这项活动,对每种技术可能答案可以在下表中找到。

技术 | 足迹 (主动数据收集) | 指纹 (被动数据收集) | 用户收益 |

社交媒体平台(如Facebook、Instagram或TikTok) | 点赞、帖子、朋友/关注者、带标签的地点、照片、视频、信息、用户标签、使用的标签、你属于哪个组、私人信息的内容、性格测试中你最喜欢的答案 | 你查看的资料,你查看的广告,你点击的链接,你在应用上花费的时间,你在一天中的什么时间使用应用,在哪里使用应用 | 与朋友联系,人们喜欢你的内容,发现新事物 |

搜索引擎/网页浏览 | 访问网站的搜索历史 | 你浏览或点击的广告,你点击的链接,浏览所花的时间,你的物理位置,你的语言,搜索的位置,搜索时使用的设备类型 | 发现新事物;访问你喜欢的网站;个性化搜索结果;基于你的预期年龄、性别、兴趣或位置的定向广告或产品推荐 |

音乐和视频APP(如Spotify或YouTube) | 你的“喜欢”,你关注或订阅的账户,播放列表内容,听或查看历史记录 | 你播放某歌手、歌曲或视频的次数;你喜欢类型;你喜欢的话题或标签;一天中你听或看的时间;你听或看多久 | 享受你最喜欢的歌曲和视频;发现新媒体;轻松地组织你的整个音乐库在一个地方;保存和共享播放列表;与朋友分享媒体 |

GPS /地图APP | 你想要到达的位置,你搜索的位置,你当前的位置 | 你住在哪里,你的日常生活,经常去的地方,你开车的速度,基于位置的兴趣(食物,娱乐,等等),你到达和离开地点的时间,你和谁在一起(从你和谁一起的位置数据) | 很容易到达你要去的地方,获得实时交通信息 |

自适应教育APP(如可汗学院) | 姓名,老师,学校,年级,你正在学习的课程,你对练习问题的答案,你在不同学校科目中的表现,你正在上的课程 | 掌握一个主题需要多长时间

| 帮助你学习课程,关于掌握和进步的信息,在学习了一个主题后尽快浏览材料,而不是完成所有的问题 |

网上购物 | 你买了什么,你存了什么,你的生日(为了促销) | 你在看什么,你购物车里有什么,你或你父母的信用卡信息,你的地址,你在他们的网站或应用上花了多少时间 | 送货上门,方便快捷,个性化推荐 |

智能家居设备(如门铃、智能恒温器、Echo或谷歌home) | 谁在你的门口;你给它什么命令或提示;您喜欢什么温度? | 当你从家里出来或来的时候;你在自己家里私下谈论什么 | 方便,家庭安全,节能 |

可穿戴技术(如苹果手表、Fitbit、睡眠跟踪器、智能眼镜、智能医疗设备) | 一天的步数,心率,血糖水平,快速眼动周期 | 传感器融合数据,如工作时的心脏BPM(心率监测器+ GPS) | 实时获取健康数据,方便抬头显示。 |

3. 通过考虑他们列出的分享数据带来的可能风险或意外后果,扩展学生对他们在网上分享数据的思考。

1)说:“当我们在网上共享数据,我们总是不知道怎么样,或者为什么我们共享的数据——脚印或指纹——被计算机程序或公司使用——甚至被卖给政府或第三方用于完全不同的目的。有时,我们分享自己认为无害的信息,但就其本身或与其他信息结合时,可能会导致意想不到的后果或用途。”

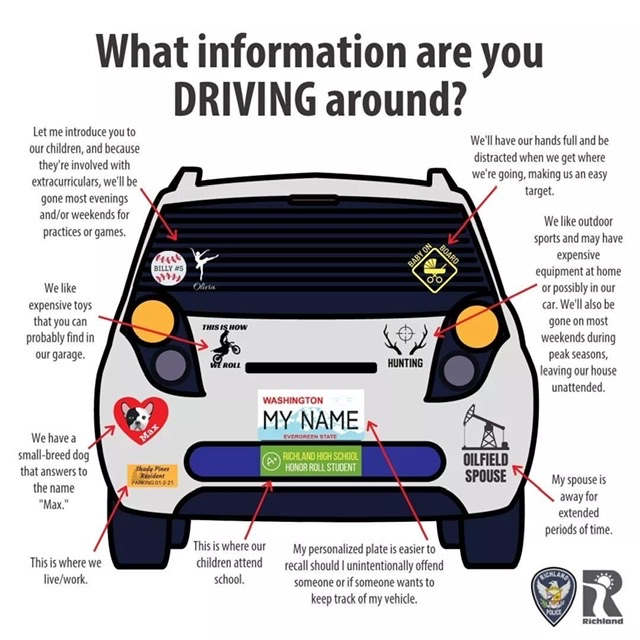

2)设计一个信息图“What Information Are You Driving Around?”给全班同学看。仔细阅读每个保险杠贴纸所揭示的信息,以及人们可能无意中理解、使用或滥用这些数据的方式。

3)回顾你的学生在上表中列出的有关技术的足迹和指纹,或者他们想到的其他技术。问:“除了你们刚才列出来的共享数据提供的用户收益之前,个人、公司或政府还可能如何使用或滥用你所说的每项技术收集的数据?”当他们聚合或合并这些应用程序共享的数据来创建你的数字档案时,他们可能会知道或做什么?如果他们提供或出售这些数据给其他公司和政府,会发生什么呢?” 例如,当学生发布他们的照片和他们最喜欢的东西的列表时,有人可能会利用这些信息猜测他们的密码,找出他们的安全问题答案,或模仿他们。或者,一家公司可能会根据用户的行为或他们所消费的媒体主题来评估他们的医疗或心理健康状况。

4)告诉学生,条款和条件是了解APP应用程序或公司可能如何使用他们的数据,以及该APP应用程序或公司是否在保存、删除、共享甚至出售他们的数据的一种方法。询问学生是否阅读过他们下载的APP应用程序的条款和条件。讨论为什么或为什么不,以及有选择地使用APP应用程序和共享哪些数据的好处。

5)通过揭示所有人工智能技术在设计和使用中存在的权衡来总结活动。虽然您和您的学生能够列举每种技术的许多优点和用户利益,但使用这些相同的技术也有潜在的缺点和意想不到的负面后果。当我们选择使用人工智能技术时,我们对相关的权衡做出了决定,比如使用APP地图应用程序的便利性,但放弃了我们在哪里和我们要去哪里的隐私。

5. 活动3:好、坏和权衡

在最后一项活动中,学生们探索了分享个人数据和使用人工智能工具的好处之间的权衡。在本次活动中,学生将探索人工智能目前的使用方式;这些用途对人、社会或环境可能产生的影响;以及这些技术所代表的权衡。

1. 通过以下关键概念介绍本次活动:

1)在上一项活动中,你们思考了在分享个人数据和在日常生活中使用人工智能工具获益之间的权衡。现在,让我们想想其他的人工智能应用,以及人工智能可能不仅会影响用户,还会影响社会和环境的一些方式。

2)衡量人工智能伦理影响的一种方法是确定它是否与社会公益(Social good)相一致。社会公益通常被认为是一种以最大可能的方式让最大数量的人受益的东西。换句话说,它不仅对一个人或一小群人有益,而且对整个社区或社会有益。人工智能在解决世界各地的人道主义、社会和环境问题方面具有很大的潜力。

3)正如我们在上一个活动中所考虑的,使用人工智能技术的影响可能是积极的,也可能是消极的,或者两者兼有。那些对人工智能技术感兴趣、能够影响或受其影响的人被称为利益相关者(stakeholders)。利益相关者不仅包括用户,还包括开发人员、销售人员、公司所有者、环境、政府或任何受其使用影响的人。有时,对一组利益相关者有利的事情,对另一组可能是不利的。

2.使用拼图教学策略(jigsaw instructional strategy),将下表中的一个或多个人工智能技术类别分配给每个人或每个小组。使用提供的图形组织者或其他你选择的方法,让学生使用提供的问题和资源研究他们指定的技术,并记录他们的发现。一旦学生完成了他们的研究,让他们向全班报告他们的发现。理想情况下,学生也会在其他学生的演讲中做笔记,这样他们最终会对各种人工智能技术是如何使用和影响各种利益相关者有一个丰富的理解。

注:所提供的《人工智能技术的权衡:活动3图形组织者》(The Trade-offs of AI Technology: Activity 3 graphic organizer)为谷歌Doc格式。当你准备这个活动时,制作你自己的可编辑的副本,编辑或更新你需要的问题或资源,并以你喜欢的格式分发给你的学生。

学生需要回答的问题:

1)这种技术的目的是什么?给出具体的例子。

2)你对这项技术的工作原理了解多少?

3)用户的哪些数据正在被收集?

4)谁是这项技术的利益相关者(即,谁是用户、创造者和受其影响的其他人)?

5)哪些利益相关者受益于这项技术,以及如何受益?

6)哪些利益相关者可能会受到这项技术的损害,以及如何受到损害?

7)除了你所描述的目的之外,这项技术或数据还有哪些其他用途?

8)这项技术或数据还有哪些可能被滥用?

9)如何描述人们在使用这项技术时必须接受的权衡?(例子:人们通过放弃……得到……。)

选择以下任何或所有类别和资源,或根据当前事件和相关学生兴趣提供其他类别和资源。请注意,这些类别并不全面,有时还会重叠,但应该提供各种切入点,以结合学生的文化、经历和兴趣。

人工智能技术类别

类别 | 学习 | 探索 | 思考 |

AI聊天机器人和同伴 聊天机器人是一种模拟人类对话的软件程序。聊天机器人以虚拟助手、对话代理、伙伴甚至人工智能社交媒体影响者的形式出现。 | 视频: “What are Chatbots?” 视频: “Google Duplex” 视频: “This robotic therapy seal is revolutionizing elderly care” 文章: “Why Are Brands Using CGI Influencers to Promote Skin Care and Fashion?” 文章: “What future for humanoid robots?” | 艾丽斯(ALICE) 一个获奖的会话代理 | 人工智能聊天机器人或伴侣是否有使用或不使用的方式(例如,用于友谊,作为浪漫的伴侣,或伪装成人类客户服务代理)?为什么? 以聊天机器人的形式再现已故者的声音或外貌会带来哪些伦理问题? |

AI生成的媒体 人工智能技术被用于生成声音、图像、深度假视频,甚至新闻。 | 视频: “Sway Launches #CoolRanchDance in Partnership with Doritos: Join the AI Dance Challenge!” 视频: “Behind the Scenes: Dali Lives” 互动游戏: Choose Your Own Fake News 文章: “What are Deepfakes?” 文章: “Should AI Bring Dead Voices To Life?” | This Person Does Not Exist: 刷新以查看AI生成的人脸. This Cat Does Not Exist: 刷新查看AI生成的猫. | 一些人认为,虚假内容可能与网络安全漏洞一样有害或恶意,企业和政府应该采取相应的行动。这在哪些方面是真实的或不真实的?假媒体是如何影响我们辨别真假的能力的? 谁拥有你的声音和图像数据重要吗?如果它是政府vs公司呢?本地公司vs外国公司?盈利性还是非盈利性? |

人工智能个性化机器学习允许人工智能技术使用关于你和你喜欢的人的数据,以个性化的事情,如教育智能辅导系统,有针对性的广告,媒体推荐和搜索引擎结果。 | 视频: “Recommender Systems: How YouTube Knows What You Should Watch” 文章: “What is Targeted Advertising?” 文章: “How ‘Intelligent’ Tutors Could Transform Teaching” | 谷歌广告设置: 如果你登录谷歌帐户,你可以看到公司是如何个性化的广告显示。 Flexi: Flexi智能数字数学导师不仅提供提示、提醒和支持,还根据你对前面问题的回答,调整更难或更容易的后续问题的练习。在这里了解更多关于它是如何工作的。 | 通过推荐或推动来操纵人类行为的个性化结果的伦理影响是什么? 人们是否应该担心花在观看视频或消费人工智能算法推荐给我们的其他媒体上的时间? |

AI生成的艺术使用人工智能工具,人们可以创作视觉艺术、音乐、诗歌、舞蹈或其他艺术作品——甚至可以采用其他艺术家的风格。 | 文章: “Would You Buy This AI Painting?” 文章: “Computers are Changing How Art is Made” 文章: “What is AI Generated Art?” 文章: “AI can make music. But will it replace your favorite musician?” 文章& 视频: “12 Songs Created by AI” | 演示: MuseNet 演示: AI Duet 演示:Doodles to Pictures | AI生成的艺术也算艺术吗? 谁应该拥有人工智能生成的美术作品? |

人工智能自动化人工智能技术是将以前由人类和动物等有生命的智能生物执行的任务自动化。 | 视频: “Microsoft is accelerating the journey from automated to autonomous systems” 文章: “How Will Automation Impact Our Lives?” 文章: “A robot referee can really keep its ‘eye’ on the ball” 文章: “How to fight online hate before it leads to violence” 文章: “Moral dilemma could limit appeal of driverless cars” 网页: Automated Vehicles for Safety | Moral Machine:尝试做出合乎道德的决定对于自动驾驶车辆 | 在什么情况下,让自动化人工智能技术执行以前由人类工人完成的任务可能是一个道德问题,为什么? 人们应该如何决定什么时候应该使用自动化技术(例如,如果人工智能做得更快,错误更少,执行对人类危险的任务,工作没有偏见,等等)? |

人工智能辅助技术 人工智能可以被用来为帮助有不同需求和能力的人的技术提供动力。 | 视频: “Seeing AI: Making the visual world more accessible” 视频: “How to Translate Spoken Word into Sign Language on Your Phone” 文章: “Computers can translate languages, but first they have to learn” 网页: Microsoft.com AI for Accessibility | 演示带字幕的幻灯片:按照以下说明让机器学习在演示谷歌幻灯片时生成字幕。 在演示文稿中使用Microsoft Translator:在演示PPT时,按照说明让机器学习以您选择的语言生成字幕。 | 你认为从长远来看,辅助技术会帮助还是阻碍人类智能? 机器应该决定帮助谁,伤害谁吗? |

人工智能识别 当我们谈论人工智能识别时,我们谈论的是使用模式正确识别和标记图像、声音或文本的人工智能算法。 | 视频: “Gender Shades”Article and Video: “New device tells smiles from frowns—even through a mask” 文章: “Researchers Are Using Facial Recognition Software To Save Lions” 文章: “Artificial Intelligence: From Croissants to Cancer” 文章: “Facial recognition technology: The need for public regulation and corporate responsibility” | Google Lens or Google Search by Image(谷歌镜头或谷歌图像搜索) Erase Your Face | 既然更大的监控导致更多的数据收集,从而导致更准确的人工智能,我们应该如何在数据隐私和技术进步之间找到平衡?人们应该担心少数公司或政府拥有或访问大量关于人的数据吗? |

6. 活动4:人工智能政策

在上个活动中,学生们探索了各种人工智能技术的利弊,揭示了这些技术如何能够帮助人们,也揭示了它们可能造成的伤害或伦理困境。在本次活动中,学生们将考虑政策或法规是否有助于确保人工智能技术只用于好的方面。

1.总结学生在上一次活动中学到的东西,如果人工智能在社会中帮助人们,并符合人们的价值观,它可以是有益的,但如果它被编程做一些有害的事情,或如果它在实现好事的过程中具有破坏性,它可能是危险的。

2.告诉学生,许多行业、政府和公民组织正在倡导或建立指导方针、政策、法规和法律,以确保人工智能的道德设计和使用。虽然违反其中一些规定,如美国联邦贸易委员会(FTC)的规定,可能会给公司带来法律后果;其他政策,如公司的道德准则,只是公司内部努力遵守的目标,违反可能并不总是有后果。分享下面的资源列表(或其他政策资源),并给学生一些时间来探索它们。告诉他们选择两个来更仔细地探索。

- USA Federal Trade Commission Guidance

- European Union’s Ethics Guidelines for Trustworthy AI—Press Release

- Hong Kong’s Ethical Accountability Framework

- Artificial Intelligence at Google: Our Principles

- Microsoft’s Responsible AI page

- IBM: Everyday Ethics for Artificial Intelligence

- Partnership on AI’s Goals and Thematic Pillars

- USA Children’s Online Privacy Protection Act (COPPA): FAQs on COPPA and Schools

- The Institute for Ethical AI in Education’s The Ethical Framework for AI in Education

3.使用维恩图,让学生比较和对比他们选择的两个例子。他们不需要完整地阅读资源,而是应该试图找到他们的例子如何处理偏见、公平、透明度、可解释性、问责性或价值观等主题的主要观点。学生完成了他们的维恩图之后,让他们分享在检查的道德准则中发现的共同主题。

4.告诉学生谷歌最近提出的一项帮助解决这些问题的创新被称为模型卡。模型卡提供了一个整体框架,用于共享机器学习模型的信息,例如:目的和受众、设计和培训数据、实现限制和权衡。谷歌表示,这些模型卡可以由许多开发人员创建,并将提高各种利益相关者对人工智能的透明度。在这里仔细看看谷歌模型卡的两个例子(https://modelcards.withgoogle.com/model-reports)。

5. 用一场关于人工智能伦理责任的课堂讨论来结束本次活动,提问如下所示。帮助学生理解所有利益相关者,甚至是用户,对合乎道德的人工智能设计和使用分担责任。所有利益相关者都可以在决定人工智能未来将如何使用方面发挥作用。

- 你认为哪个更有效:私营企业自我监管,还是政府制定法律来监管人工智能的设计和开发?为什么?

- 谁负责确保人工智能的设计和实施符合道德?谁应该为此负责?为什么?

7. 活动5:参与人工智能决策

在这个最终的表演中,学生将综合他们在这个项目中学到的知识,阐明并支持人工智能政策的立场。根据您个人的教学风格和您的学生的兴趣,您可以选择其中一项或两项活动。这两项活动都强调了数字公民和倡导(advocacy)在一个充满人工智能的世界中的重要性。

1)通过向学生介绍数字公民的概念来开始这一部分。根据ISTE学生标准,一个好的数字公民是“认识到在互联的数字世界中生活、学习和工作的权利、责任和机会,以及以安全、合法和道德的方式行事和树立榜样的人。”这是一项至关重要的技能,尤其是在一个日益依赖人工智能的世界里。

2)DigCitCommit Coalition定义了五种数字公民能力:包容、知情、参与、平衡和警觉。让学生们观看30秒的视频“投身数字公民!”(Commit to Digital Citizenship!)来介绍这些概念。在黑板上展示五项能力,并让学生分享他们如何看待这些概念,以及他们在这个项目中所学到的关于人工智能的知识。

3)告诉学生,他们将有机会把所有五个能力采取行动在剩余的项目活动,尤其是“订婚”能力,定义为“能够使用技术和数字公民参与渠道,来解决问题,是一个善的力量在这两个物理和虚拟社区”。在这两种选择中,他们会考虑各种行动呼吁——告诉某人他们下一步应该采取什么行动,而利益相关者可能会要求决策者采取什么行动。

选项A:模拟人工智能监管委员会会议

在最终表现选项A中,学生将应用他们从上次活动中学到的知识,考虑围绕人工智能技术的开发和使用的政策和法规。学生们将在一个虚构的全球机构——世界人工智能监管组织(WAIRO)的关键会议上扮演利益相关者倡导者和决策者。在你的时间和学习环境允许的情况下,这个活动可以是简单的,也可以是复杂的。

1)通过让学生们知道他们将在虚构的、但潜在非常有影响力的WAIRO的模拟全球监管理事会会议中扮演角色,应用他们在上次活动中收集的研究,来介绍这个活动。解释这个活动反映了利益相关者代表在学校董事会、城市委员会或立法机构面前为他们的选民辩护的样子。

2)建立WAIRO会议的角色。

- 3 - 5个委员会成员。这些学生将坐在教室的前面,听取不同利益相关者的意见,并试图共同努力,为世界创造一个统一的人工智能监管政策。(另一种有趣的做法是,学校领导或社区成员可以担任理事会成员。)

- 3 – 7名利益相关者代表。这些学生将向委员会成员提出三分钟的辩论,具体讨论特定利益相关者希望他们如何就人工智能监管做出决定。可能的利益相关者群体包括:13岁以下的儿童、初高中学生、消费者、大型人工智能软件公司、小型人工智能初创企业、人道主义组织、环境活动家、政府组织,或活动3期间出现的任何其他利益相关者。

- 利益相关者。其余的学生应该与利益相关者代表组成伙伴关系或小组,帮助他们准备向委员会提交的意见。

3)给学生时间准备模拟会议。鼓励学生从之前活动中探索的资源中获取具体的例子和支持证据,以确定他们在自己的角色中会如何思考要解决的政策或法规类型。

4)模拟会议期间:

- 给每位利益相关者代表三分钟时间向理事会陈述他们的论点。也可以选择给委员会成员时间去问利益相关者的后续问题。

- 给理事会成员10-15分钟时间,审议并制定关于人工智能使用、权利或限制的政策决议。这个清单可能包括该做什么和不该做什么,以及违规行为是否会被视为民事或刑事违规或招致任何类型的惩罚。课堂上的其他同学应该成为这些讨论的听众。最终的政策决议应该只包括理事会成员在给定时间内能够达成一致的内容。

5)模拟会议结束后,用下列问题进行汇报:

- 根据WAIRO委员会通过的政策或法规,每个利益相关者群体会受到怎样的影响?

- 如果理事会不能就利益相关方代表要求的某些政策或法规达成一致,这种行动的缺乏会如何影响利益相关方群体?

- 查看五项数字公民能力的名称和描述,您如何看待这些技能在人工智能政策的发展中发挥作用?

选项B:人工智能行动呼吁

在最终表现选项A中,学生们考虑了多个利益相关者的观点,以及他们可能如何受到各种人工智能政策或法规的影响。在选项B中,学生将采取个人的人工智能政策立场,并通过媒体人工制品进行交流。

1)让学生以个人、合作伙伴或小组的形式工作,创造一种人工智能相关的特定行动呼吁。人工制品可能是一封信,一篇有说服力的文章,一个博客,一个视频,一个播客,或者他们选择的其他媒介。人工制品应该包括:

- 谁:特定的政策制定者听众,如家长、学校领导、州领导、公司或商界领袖或政府官员。

- 内容:针对受众的行动呼吁,如:制定具体的政策或法规;学习更多关于特定人工智能主题的知识;邀请客座演讲者或顾问;将人工智能教育纳入学校课程;对教师和学生进行人工智能数据隐私的培训;或者以特定的方式使用人工智能来帮助人们。

- 何时:执行此操作的建议时间线。

- 理由:至少有两个支持证据的例子,解释为什么需要采取行动,为什么它将使人们受益,以及为什么这项政策的好处将超过潜在的风险或危害。

注意:很有可能一些学生会支持在某些方面似乎不道德的职位。当评估这项任务时,考虑他们是否满足任务标准,他们的支持证据是否与他们的行动呼吁一致,以及他们是否建立了一个论点,即他们的权衡所带来的损害是如何被行动呼吁带来的好处所压倒的。

2)一旦学生创建了他们的作品,让他们通过画廊散步(a gallery walk)或课堂展示的形式与全班分享。学生可以与他们选择的观众分享他们的作品。

8. 活动6:反思回顾

在这个活动中,学生讨论以下问题:

- 要做的道德事情总是显而易见的还是不证自明的?不同的利益相关者会如何看待相同的关于公平和道德的人工智能设计的决定,或以不同的方式使用?

- 如果政策制定者不能就如何使用人工智能的规定达成一致或选择不采取行动,会发生什么?如果不制定政策或法规来规范合乎道德的人工智能设计和使用,可能会有什么后果?

- 你将如何继续学习和倡导合乎道德的人工智能设计和使用?